Mai trece o zi și mai aflăm de încă o problemă de securitate asociate AI-ului: de data asta e vorba despre Whisper Leak, un tip de atac ce permite identificarea subiectelor conversației cu un AI, cu potențiale efecte îngrijorătoare.

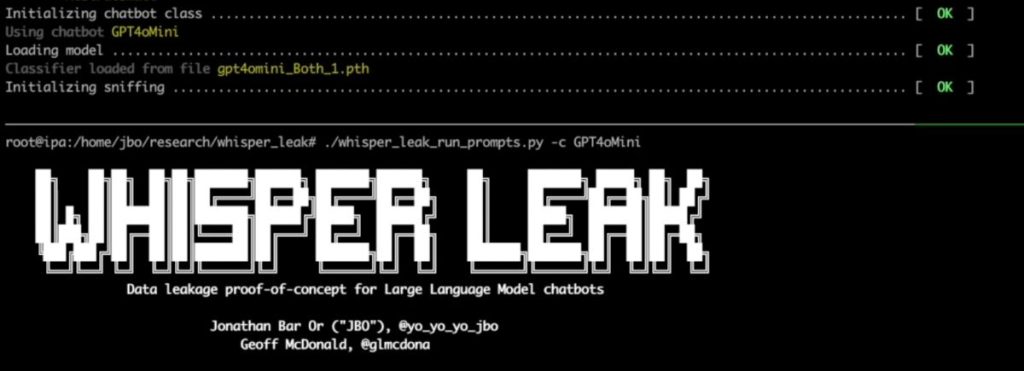

Whisper Leak este identificat de Microsoft ca o problemă asociată modului în care se desfășoară conversația cu un AI, unde un atacator cu suficiente resurse ce poate să observe traficul dintr-o rețea, are posibilitatea de a identifica cu un grad foarte ridicat de acuratețe, ceea ce se discută cu AI-ul. Jonathan Bar Or și Geoff McDonald din Microsoft Defender Security Search au publicat un material în care discută despre acest tip de atac și trag un semnal de alarmă vizavi de implicațiile sale. Prin analiza dimensiunii pachetelor, a timpului de răspuns și a modului în care acestea se repetă în timpul comunicației cu un AI, e posibil să se poată detecta subiectul conversației, în ciuda faptului că traficul este criptat. Și atacul a funcționat pentru 29 din cele mai populare modele, unele dintre ele cu un grad de certitudine de aproape 100% pe anumite subiecte.

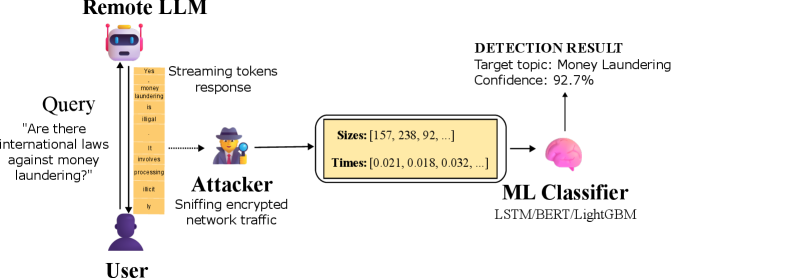

Fain este că pentru atac a folosit tot un AI, care a fost antrenat pe un anumit subiect, cerându-se să se genereze 100 de întrebări similare, dar formulate diferit și pe baza lui s-au urmărit timpii de răspuns și în general, comportamentul în rețea. Punctual s-a ales subiectul de spălare a banilor, pentru care rata de identificare a fost extrem de interesantă, după cum se poate vedea în tabelul de mai jos.

Modelele Alibaba, DeepSeek, Mistral, Microsoft GPT sau OpenAI dau în vileag aproape complet subiectul conversației și un atacator care are posibilitatea de a monitoriza rețeaua poate identifica corect anumite chestii de care ar fi interesat. Cred că trebuie să specific că în cazul de față, vorbim de atacatori care au posibilitatea fizică și financiară să execute astfel de atacuri, în speță guverne, dar nu exlud nici organizații criminale bine organizate.

Vă dați seama că probabil treaba asta e deja aplicată: monitorizând traficul pe ChatGPT (că acolo par să se ducă toți internauții), unei agenții guvernamentale îi va fi foarte ușor să identifice utilizatorii care cer detalii despre subiecte … ‘interesante’ cel puțin.

Tot în raportul legat de Whisper Leak se spune că modelul de atac poate fi îmbunătățit în timp, prin creșterea volumului de date cu care este antrenat. Partea bună este că Microsoft, Mistral, xAI au fost înștiințați și au venit cu ceva măsuri de a contracara acest tip de atac – o soluție relativ simplă este să se crească artificial volmului pachetelor, introducând secvențe variable de text în fiecare pas al conversației.

Acum că știți treaba asta, aveți grijă ce întrebați AI-ul și mai ales de unde o faceți și prin ce aparate. Și dacă vreți să studiați mai multe despre Whisper Leak (ce este, cum funcționează, codul sursă), citiți materialul de pe site-ul Microsoft.

Git: Whisper Leak