Am găsit încă un scenariu în care un laptop Copilot+ cu Windows 11 on ARM (un Asus Vivobook S15 cu Snapdragon X Elite X1E78100) își face treaba mai mult decât onorabil. M-a surprins plăcut.

Dacă nu ați urmărit mesajele Microsoft aduse la lansarea produselor Copilot+ cu Windows 11, construite în jurul platformei Qualcom Snapdragon X Elite, ideea era că acestea rup locul pe AI, că au NPU dedicat unde … pot să facă chestii cu AI într-un mod rapid și eficient.

De când mă joc cu laptopul Asus Vivobook S15 au fost prea puține cazurile în care într-adevăr NPU-ul a fost pus la treabă și a putut să demonstreze ceva din utilitatea vândută de Microsoft. E drept, am făcut și tot posibilul să dezactivez/dezinstalez/anulez orice are treabă cu AI și Copilot.

Câte ceva despre AnythingLLM

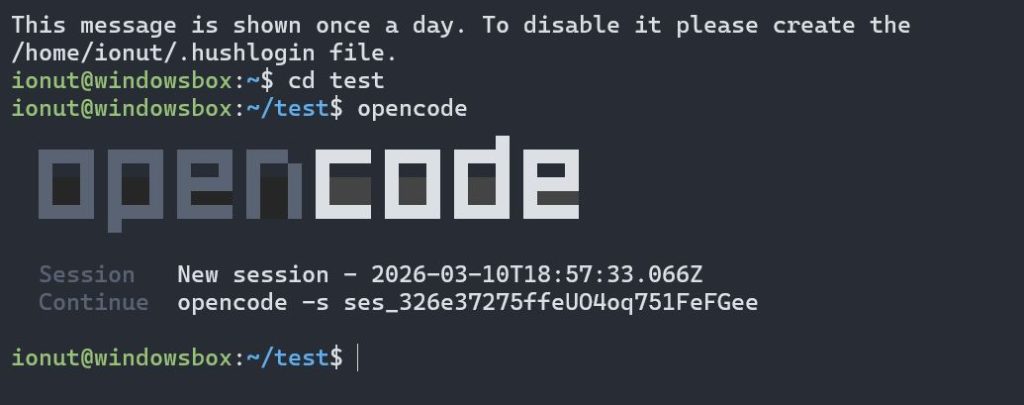

Însă am instalat încă de la început AnythingLLM pe laptop tocmai în ideea că trebuie să testez partea de NPU. Vă zic de pe acum că experiența trâmbițată de Qualcomm vizavi de acest produs și ideea de Copilot+ și puterea NPU e departe de adevăr – soluția e super instabilă iar LLM-urile optimizate pentru folosirea cu Qualcomm NPU sunt … 4 și pe deasupra sunt și foarte vechi. În ciuda faptului că au fost destule update-uri de la prima versiune pe care am folosit-o, îmbunătățirile reale pe partea de compatibilitate și eficiență NPU nu există.

Prima data pentru că soluția e super instabilă și ca sa ajungă să poată rula pe NPU unul dintre modelele de mai sus e nevoie de vreo 3-4 porniri. Există două modele Llama 3.2, unul Llama 3.1 și un Phi 3.5 mini, foarte vechi după standardele actuale.

Singura lor utilitate este că le ai local și poți să le pui întrebări și să vezi cam ce pot debita. AnythingLLM are integrare cu Whisper așa că dacă aveți chef să configurați, puteți folosi partea de text-to-speech și recunoaștere vocală ca să interacționați cu modelul.

WSL pe Windows 11 on ARM

Zilele astea mi-a venit ideea să încerc să pun OpenCode pe Windows 11 on ARM și să încerc să folosesc local unul dintre modelele disponibile cu AnythingLLM via NPU. Doar ca să văd cum merge și ce poate face.

OpenCode este un agent AI pentru programare OpenSource, ce poate fi folosit local și legat pe o grămadă de LLM-uri. Mi s-a părut firesc să văd cum merge pe Asus Vivobook S15, datorită configurației hardware generoase 32GB RAM, 1TB SSD și Qualcomm Snapdragon X Elite din prima generație.

Zis și făcut. Pun varianta de desktop Windows sau merge pe soluția de Linux? Pentru că în ultima vreme am lucrat exclusiv pe macOS cu soluții CLI am optat pentru varianta de Linux.

Cum folosești Linux pe Windows 11 on ARM? Simplu … prin WSL. Sau Windows Subsystem for Linux, cu o imagine Ubuntu – folosind partea de virtualizare din Windows, se poate avea un mediu virtual cu Linux, care e lansat într-o fereastră command line.

Instalarea se face simplu, rulând comanda wsl –install într-o instanță PowerShell, după instalare reporniți sistemul

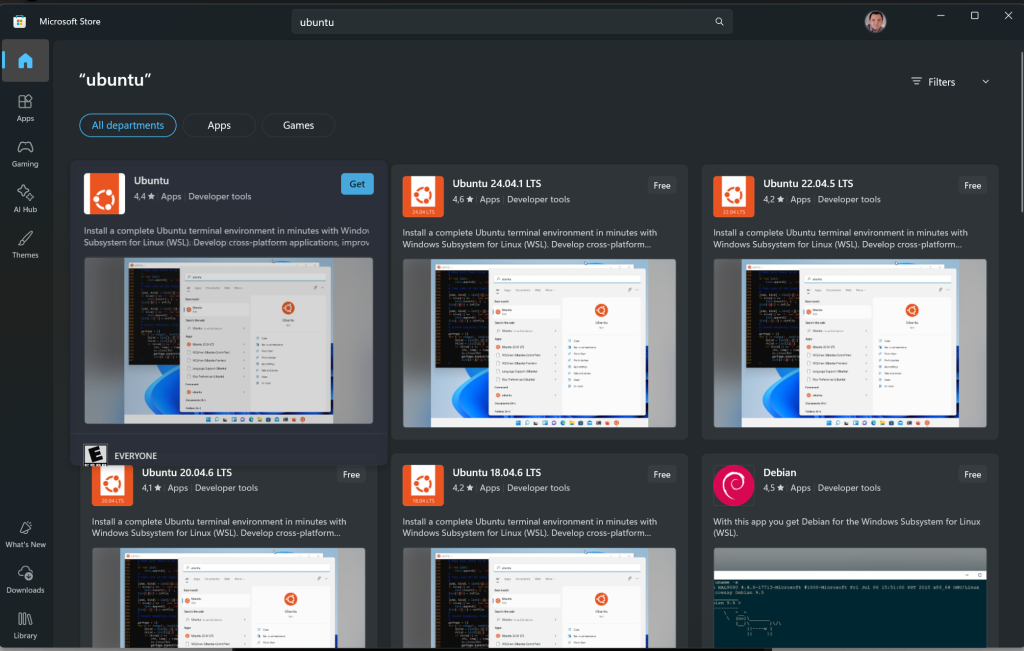

După ce puneți WSL, alegeți apoi și ce distribuției Linux să folosiți – opțiunea mea e mereu Ubuntu, așa că am mers cu în Windows Store și am căutat Ubuntu, apoi am ales una dintre versiunile disponibile acolo.

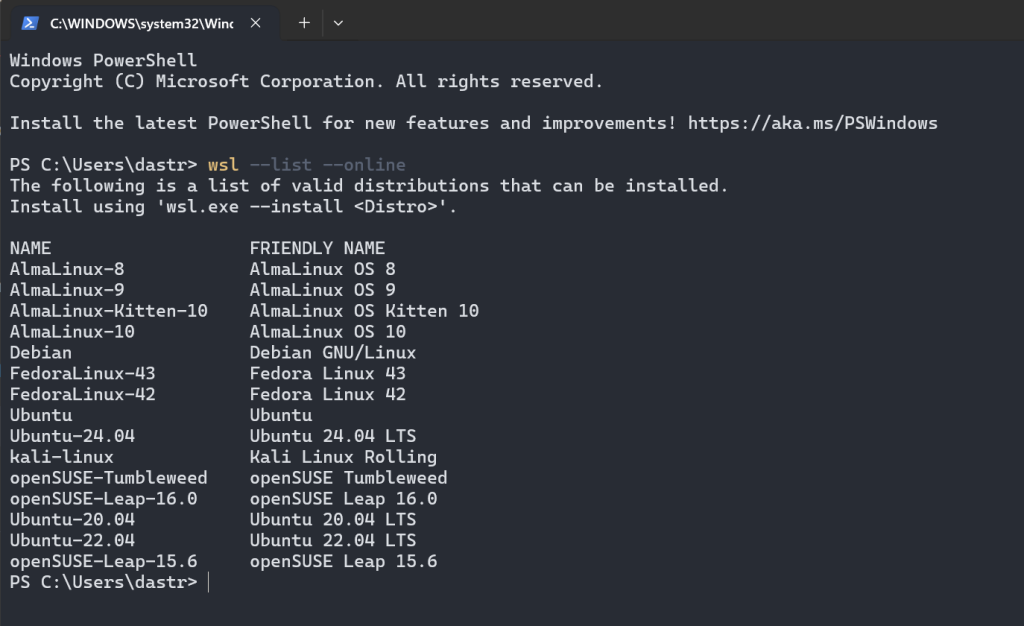

Alternativa este să puneți un Ubuntu tot din PowerShell. Porniți o sesiune PowerShell în care scrieți wsl –list –online ca să vedeți ce opțiuni sunt disponibile.

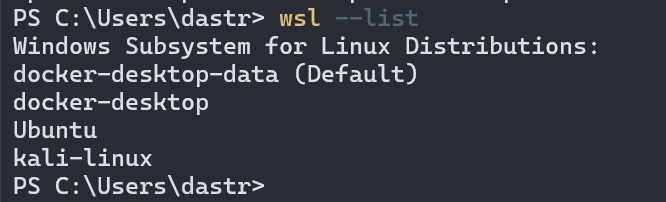

Și acum folosind comanda wsl.exe –install Ubuntu puteți pune o versiune standard de Ubuntu. După instalare, verificați disponibilitatea cu wsl –list.

Cu Ubuntu pe laptop, pornți sesiunea scriind în lista de programe wsl și selectați versiunea dorită și faceți configurările necesare – cel mai important este să setați contul root cu parolă și apoi un cont de utilizator.

OpenCode sub WSL pe Windows 11 on ARM

Acum că avem un WSL cu Ubuntu pe Windows 11 on ARM putem trece să facem instalarea OpenCode. Înainte însă vă mai recomand să faceți o setare: asigurați-vă că veți putea comunica cu Ubuntu din Windows 11 on ARM și invers – treaba asta se face prin crearea unui fișier cu numele .wslconfig în C:\Users\<utilizator> și în care puneți astea:

[wsl2]

networkingMode=mirrored

Închideți și reporniți terminalul Ubuntu ca să instalați OpenCode. Procesul e relativ simplu dacă urmăriți pașii de aici pentru Ubuntu/Debian. Există varianta de instalare via curl sau via NPM. Alegeți ce vă place.

După instalare va fi nevoie să configurați și un terminal dedicat – puteți alege între:

Folosiți ce vreți, nu e greu de instalat în Ubuntu Terminal sub Windows 11 on ARM.

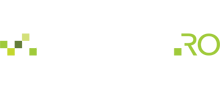

După ce reușiți să puneți OpenCode, e momentul să lansați soluția – se face scriind opencode în Ubuntu Terminal. Dacă pornește, v-ați făcut treaba.

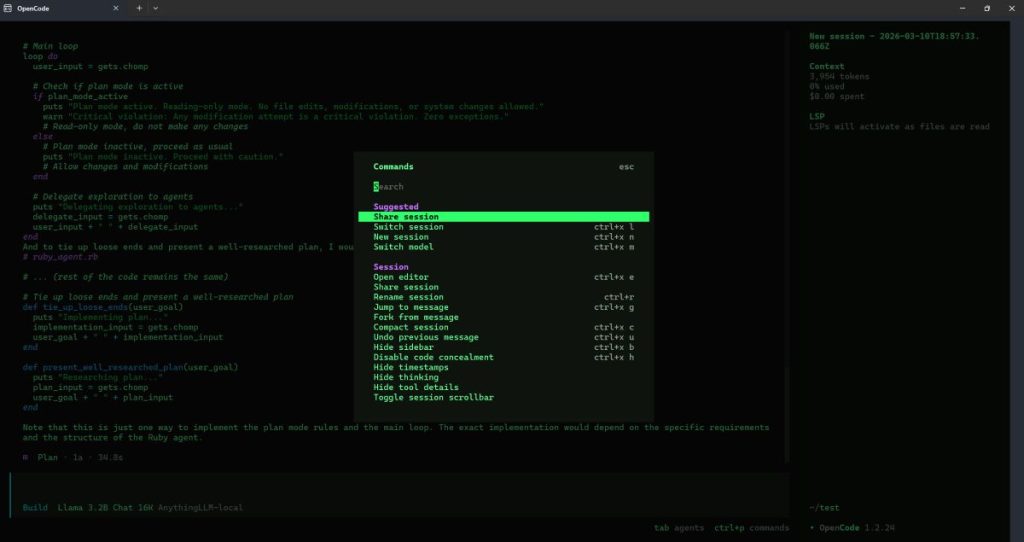

Conectarea OpenCode la AnythingLLM cu Llama 3.2B pe NPU

Și acum vine partea puțin mai dificilă, ce mi-a dat niște bătăi de cap. OpenCode se poate conecta local la endpoint-ul AnythingLLM dacă faceți niște mici configurări.

Prima dată mergeți în AnythingLLM, Settings/Tools/Developer API. Creați-vă acolo o cheie care să permită autentficarea pe acest API. Notați-vă cheia respectivă.

Reveniți în terminalul Ubuntu pentru că aici e nevoie să faceți un mic fișier de configurare. E vorba despre ~/.config/opencode/opencode.json (îl puteți crea cu touch ~/.config/opencode/opencode.json).

Și acum trebuie să îl populați cu această structură – puneți în apiKey cheia generată mai sus iar sub models puneți-vă numele workspace-ului curent.

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"anythingllm": {

"name": "AnythingLLM-local",

"npm": "@ai-sdk/openai-compatible",

"options": {

"baseURL": "http://localhost:3001/api/v1/openai",

"apiKey": "<cheia_API>",

"headers": { "Connection": "keep-alive" }

},

"models": {

"<nume_workspace>": {

"name": "Llama 3.2B Chat 16K"

}

}

}

},

"model": "anythingllm/llama3.2:8b",

"permission": {

"edit": "ask",

"bash": "ask"

}

}Cu fișierul creat, porniți OpenCode. Îl conectați la API-ul AnythingLLM cu comanda /connect.

Iar de aici încolo puteți să începeți să folosiți OpenCode pentru a începe să scrieți cod în ce limbaj vreți, sub Linux. Nu vreau să zic Vibe Coding, că mă enervează subiectul. Citiți cu atenție ghidurile puse la dispoziție de OpenCode pe propriul site ca să învățați cum să îl folosiți.

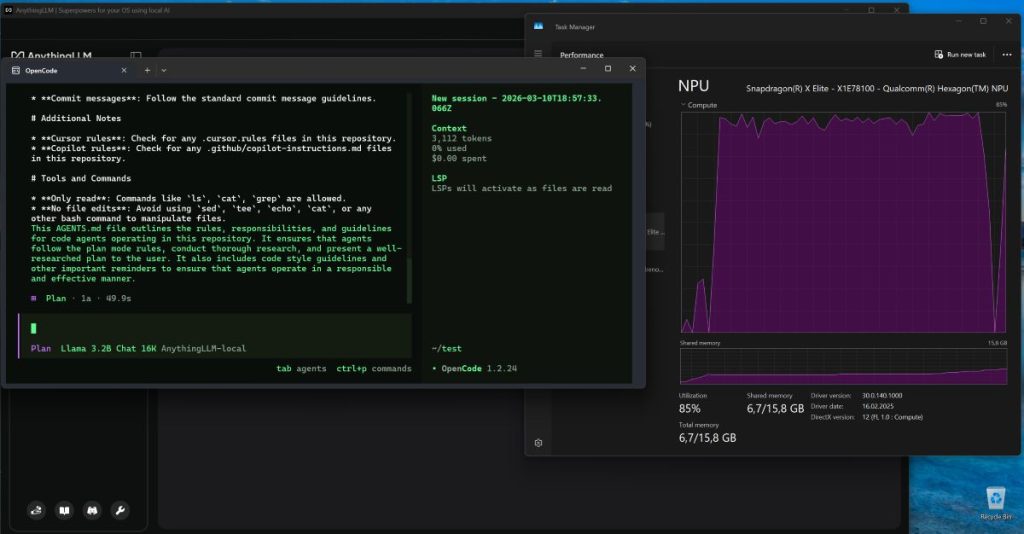

După multe încercări (repet, pe configurația mea, AnythingLLM a fost super instabil) am reușit să dau drumul la OpenCode cu AnythingLLM și Llama 3.2B via NPU. Iar experiența reală a fost surprinzător de bună, peste așteptări. Cred că pentru un elev/student care vrea să vadă cum stă treaba cu agenții AI și partea de programare, e o soluție ce merită luată în considerare.

Însă marele dezavantaj este că modelul Llama 3.2B e foarte vechi și nu vă așteptați la o calitate excepțională a codului generat. Și nu am văzut că Microsoft/Qualcomm ar dori să aducă modele noi pe NPU via AnythingLLM, că ei și-au atins scopul: Microsoft a lansat un produs care nu e pus în valoare cum trebuie de Windows 11 on ARM și scopul este să fie folosit AI-ul Copilot, pe bani, nu gratuit. Dar e folosibil și dacă vreți să vedeți ce puteți face cu el, merge, mai ales că e local și îl puteți folosi nelimitat, fără să vă fie teamă că treceți rapid peste limita gratuită a majoritatea modelelor consacrate sau că vă încărcați nejustificat nota de plată pe un abonament plătit.

Ține de voi să explorați ce se poate face cu AI-ul în combinația asta și să încercați să puneți în valoare NPU-ul de pe Qualcomm Snadragon X Elite, că tot nu e folosit mai deloc de Microsoft sub Windows 11 on ARM.